InfiniBand 技术及其在 Linux 系统中的配置简介

随着高性能计算(HPC)、人工智能(AI)和大数据分析等领域的飞速发展,传统的以太网技术在某些场景下已难以满足对高带宽、低延迟的严苛需求。在此背景下,InfiniBand 技术应运而生,并逐渐成为超算中心、数据中心和科研网络的核心互联方案。本文旨在对 InfiniBand 技术进行简要介绍,并概述其在 Linux 操作系统中的基本配置流程。

一、 InfiniBand 技术概述

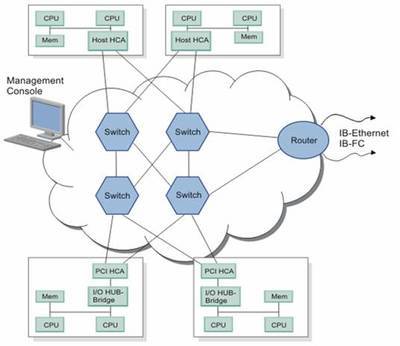

InfiniBand 是一种专为高性能计算设计的、基于通道的点对点交换结构网络互连技术。它通过将网络通信协议卸载到专用的硬件(网卡、交换机)上,实现了极高的通信效率。其主要技术特点包括:

- 高带宽与低延迟:InfiniBand 提供了远超传统以太网的带宽,当前主流标准(如HDR 200Gb/s)和未来标准(NDR 400Gb/s)持续推动性能边界。其端到端的通信延迟可低至微秒级,这对于需要频繁进行节点间通信的并行计算任务至关重要。

- 远程直接内存访问(RDMA):这是 InfiniBand 的核心特性之一。RDMA 允许网络适配器(HCA)绕过操作系统的内核和CPU,直接在应用程序的内存空间之间传输数据。这极大地减少了CPU开销、内存带宽消耗和通信延迟,显著提升了通信性能。

- 服务质量(QoS)与虚拟通道:InfiniBand 支持基于服务级别的流量管理,可以为不同应用或用户分配不同的网络资源,确保关键任务的数据流能够获得有保障的带宽和优先级。

- 可扩展性:其交换式结构支持构建大规模、非阻塞的网络拓扑(如胖树、龙鳞等),能够连接成千上万个节点,非常适合构建超大规模计算集群。

二、 InfiniBand 在 Linux 系统中的软件栈与配置简介

在 Linux 系统中,InfiniBand 的功能主要通过一系列开源软件驱动和中间件来实现,最核心的是 OFED(OpenFabrics Enterprise Distribution) 软件栈。

- 软件栈组成:

- 内核驱动:为 InfiniBand 主机通道适配器(HCA)提供底层硬件支持。

- 用户空间库:最核心的是 libibverbs,它提供了对 RDMA 操作(Verbs)的直接访问接口。在其之上,还有更高级的通信库,如 Open MPI、MVAPICH2 等,它们利用 Verbs 接口为并行计算应用提供高效的通信能力。

- 管理工具:如

ibstat,ibv_devinfo,iblinkinfo等,用于查看HCA状态、端口信息和网络拓扑。

- 子网管理器(OpenSM):InfiniBand 子网需要一个子网管理器来发现拓扑、初始化链路、分配地址和管理路由。OpenSM 是开源实现。

2. 基本配置流程:

a. 硬件安装与识别:将 InfiniBand HCA 卡安装到服务器PCIe插槽,并通过线缆连接至 InfiniBand 交换机。系统启动后,使用 lspci | grep -i infiniband 命令确认硬件已被识别。

b. 安装 OFED 软件栈:从官方网站下载对应 Linux 发行版(如 RHEL, Ubuntu)的 OFED 安装包或直接编译安装。安装后,加载必要的内核模块(如 mlx4<em>core, mlx5</em>core, ib_core 等)。

c. 配置网络接口:InfiniBand 的 IP over IB (IPoIB) 模式允许像使用普通以太网一样使用 TCP/IP 协议。使用 ip 或 ifconfig 命令可以为 ib0、ib1 等接口配置IP地址。例如:sudo ip addr add 192.168.1.10/24 dev ib0。

d. 启动子网管理器:在集群中的至少一个节点上运行 OpenSM(sudo opensm)以管理子网。对于大型或生产环境,通常需要配置 opensm.conf 文件以优化性能。

e. 验证与测试:

- 使用

ibstat检查 HCA 端口状态(应为“Active”)。

- 使用

iblinkinfo查看交换机连接信息。

- 使用

ping测试 IPoIB 连通性。

- 使用

ib<em>send</em>bw,ib<em>write</em>bw等性能测试工具(属于 perftest 包)直接测试 RDMA 带宽和延迟。

三、 网络技术研发的启示与展望

InfiniBand 的成功应用是网络技术研发面向特定领域深度优化的典范。其研发路径启示我们,解决高性能计算的瓶颈需要软硬件协同设计,将核心功能(如协议处理、内存访问)下沉到专用硬件,并为之构建高效、精简的软件栈。

当前,网络技术研发正呈现出融合与创新的趋势。一方面,源自 InfiniBand 的 RDMA 技术正在通过 RoCE(RDMA over Converged Ethernet)和 iWARP 协议向以太网渗透,试图在标准以太网上实现近似的高性能。另一方面,为了应对 AI 训练等新兴负载,更智能的网络拥塞控制、拓扑感知的通信调度、以及与计算/存储的更紧密协同,成为研发的新热点。

InfiniBand 作为一项成熟的高性能网络技术,在 Linux 生态中有着完善的支持。对其技术的理解与掌握,对于构建和维护高性能计算平台至关重要。它也为未来面向数据中心和算力中心的网络技术研发提供了宝贵的技术积累和设计思路。

如若转载,请注明出处:http://www.gyv814.com/product/79.html

更新时间:2026-04-14 04:16:36